La edad dorada de los 8 bits en Japón

Dentro de nuestra serie sobre ordenadores domésticos, es imposible ignorar un caso muy particular: Japón. Mientras en Europa dominaban máquinas como el ZX Spectrum, el Commodore 64 o los Amstrad CPC, y en Estados Unidos IBM marcaba el camino hacia la estandarización del PC, el mercado japonés siguió una evolución propia, rica, compleja y sorprendentemente fragmentada.

Un mercado muy diferente

A comienzos de los años 80, Japón vivía un auténtico boom tecnológico. Empresas como NEC, Fujitsu, Sharp o Hitachi competían ferozmente en el mercado doméstico, pero lo hacían sin un estándar dominante claro. Esto dio lugar a una variedad enorme de arquitecturas, muchas de ellas incompatibles entre sí.

A diferencia de Europa, donde el precio era clave y los ordenadores de 8 bits eran relativamente asequibles, en Japón estos sistemas eran más caros y se posicionaban también como herramientas educativas y profesionales ligeras.

El estándar de facto: NEC PC-8801

Si hubo una máquina que puede considerarse el equivalente japonés del Spectrum en cuanto a relevancia, fue el NEC PC-8801. Lanzado en 1981, evolucionó durante toda la década con múltiples revisiones.

Sus características eran avanzadas para la época:

- CPU Z80 a varias velocidades

- Gráficos de alta resolución para su tiempo

- Capacidades sonoras superiores a muchos sistemas occidentales

- Extensa biblioteca de software, especialmente juegos

El PC-88 se convirtió en la plataforma preferida para desarrolladores japoneses, dando lugar a géneros muy ligados a la cultura local, como las novelas visuales o los primeros RPG narrativos.

El gigante empresarial: Fujitsu FM-7

Otro competidor importante fue el Fujitsu FM-7, basado en el procesador Motorola 6809. Este sistema destacaba por su arquitectura particular, con CPUs separadas para gráficos y lógica, algo poco habitual en aquel momento.

Aunque menos dominante que el PC-88, tuvo una comunidad fiel y una producción notable de software educativo y juegos.

La apuesta de Sharp: X1

Sharp introdujo la serie X1, con un diseño muy cuidado y una integración visual avanzada. Fue uno de los primeros sistemas en apostar por:

- Mejor calidad de texto en pantalla

- Gráficos nítidos pensados para monitores RGB

- Interfaz orientada a usuarios más técnicos

Sin embargo, no logró alcanzar la popularidad del PC-88.

Un caso especial: MSX

Dentro de este ecosistema diverso, encontramos un intento de estandarización: MSX, impulsado por Microsoft Japón y ASCII y lanzados en 1983.

MSX sí recuerda más al fenómeno europeo en cuanto a su difusión, no así por ponerse los fabricantes deacuerdo en algo, sabido es que los joystick de una marca euroipea no servían para las otras, simplemente cambiaban el cableado para conseguirlo, pero en el MSX:

- Hardware estandarizado entre fabricantes, pero con periféricos comunes y juego en cinta o en cartucho compatibles entre todos los sistemas.

- Amplia distribución internacional

- Gran catálogo de juegos

Empresas como Sony, Panasonic y Yamaha fabricaron equipos MSX, lo que permitió cierta

compatibilidad entre modelos, algo poco frecuente en aquella época.

Los MSX se llegaron a producir en Europa, phillips apostó por ellos. El estándar tudo una mejora en los MSX2 lanzados en 1985, manteniendo compatibilidad con los ateriores mejorando memoria, gráficos y sonido, seguidos de los MSX2+ (1988), con pocos modelos, y finalmente los MSX Turbo-R (1990), mas potentes y con un procesador de 16bits, pero compatible con los anteriores al disponer de un procesador Z80 para ello (aunque con algunas dificultades), que solo lanzó Panasonic al mercado.

Juegos y cultura propia

Uno de los aspectos más interesantes de los 8 bits japoneses es su identidad cultural. Mientras que en Occidente predominaban arcades, plataformas y simuladores, en Japón surgieron géneros que marcarían el futuro del videojuego:

- Novelas visuales

- RPGs narrativos complejos

- Simuladores sociales

Muchas sagas que más tarde triunfarían en consolas nacieron en estos sistemas.

Del ordenador a la consola

Mientras que en Europa el ordenador era el centro del entretenimiento digital, en Japón el protagonismo estaba compartido con las consolas.

Nintendo lanzó en 1983 la Family Computer (Famicom), mientras que SEGA respondió con la SG-1000 el mismo año. A partir de ahí, la evolución fue rápida:

- Famicom → NES (expansión internacional)

- SEGA Mark III → Master System

A diferencia de los microordenadores, las consolas ofrecían hardware cerrado, optimizado para juegos y más accesible para el gran público.

Nintendo: diseño y control del ecosistema

Nintendo no solo creó una consola exitosa, sino también un modelo de negocio. Controlaba estrictamente la producción de cartuchos y el acceso de los desarrolladores, algo poco habitual en los ordenadores de 8 bits.

Además, introdujo periféricos y ampliaciones sorprendentes, como el Famicom Disk System, que permitía:

- Juegos en disquete regrabable

- Guardado de partidas

- Distribución más barata que los cartuchos

SEGA: potencia y arcade en casa

SEGA, con raíces profundamente ligadas al mundo arcade, apostó por trasladar esa experiencia al hogar. Sus sistemas de 8 bits destacaban por:

- Mayor capacidad gráfica en algunos títulos

- Conversiones de recreativa muy fieles

- Una orientación más "técnica" del hardware

Aunque nunca superó a Nintendo en Japón en esta generación, SEGA sentó las bases de su identidad para la década siguiente.

Otros fabricantes y sistemas híbridos

El panorama japonés no se limitó a Nintendo y SEGA. Otras compañías exploraron vías alternativas:

- NEC con la PC Engine (ya en el paso a 16 bits)

- Bandai con sistemas más experimentales

- Casio con propuestas híbridas entre consola y ordenador

En este contexto, sistemas como el MSX servían de puente: tenían teclado y capacidades de ordenador, pero también un fuerte catálogo de juegos.

Las primeras redes domésticas en Japón

Uno de los aspectos más adelantados de Japón fue la conexión en red. Ya en los años 80, existían servicios que permitían a usuarios conectarse a servidores remotos mediante líneas telefónicas.

Estos servicios ofrecían:

- Descarga de programas y juegos

- Distribución de contenido actualizado

- Juegos en línea, en algunos casos de forma asíncrona

Un ejemplo destacado fue el uso de módems en sistemas como el PC-88 o el MSX, que podían acceder a servicios propietarios similares a los BBS occidentales, pero más integrados en la oferta comercial.

El caso del Famicom y el juego conectado

Nintendo también experimentó con servicios en red. El Famicom Disk System y, más adelante, el Famicom Modem, permitían conexión con servicios remotos.

Estos servicios se utilizaron para:

- Descargar contenido

- Participar en sorteos y eventos

- Consultar información (resultados deportivos, bolsa, etc.)

Aunque limitados por la tecnología de la época, estos sistemas anticipaban claramente las actuales plataformas digitales.

Juego en grupo antes de Internet

El concepto de juego multijugador en red ya existía, aunque de forma distinta a la actual. En muchos casos, los jugadores:

- Enviaban datos a servidores centrales

- Competían por puntuaciones en rankings

- Participaban en eventos distribuidos por tiempo

También existían experiencias multijugador locales muy avanzadas para la época, con adaptadores y periféricos específicos.

Conclusión

El Japón de los 8 bits fue mucho más que una colección de ordenadores exóticos. Fue un laboratorio de ideas en el que convivieron:

- Ordenadores potentes y especializados

- Consolas optimizadas para el gran público

- Primeras formas de distribución digital y juego en red

Muchas de las características que hoy damos por sentadas —descargas digitales, ecosistemas cerrados o juego online— ya estaban presentes, en forma embrionaria, en aquella época.

Placa del Pentagon. Imagen: Wikipedia

Placa del Pentagon. Imagen: Wikipedia

Placa del Scorpion ZS-256 Turbo. Imagen: Wikipedia

Placa del Scorpion ZS-256 Turbo. Imagen: Wikipedia

ATM Turbo. Imagen: nedopc.com

ATM Turbo. Imagen: nedopc.com

Leningrad 1. Imagen: nedopc.com

Leningrad 1. Imagen: nedopc.com

Leningrad 1. Imagen: nedopc.com

Leningrad 1. Imagen: nedopc.com

BK-0011. Imagen: nedopc.com

BK-0011. Imagen: nedopc.com

Vector-06C Imagen: wikipedia

Vector-06C Imagen: wikipedia

Agat Imagen: wikipedia

Agat Imagen: wikipedia

Korvet Imagen: wikipedia

Korvet Imagen: wikipedia

UKNC Imagen: wikipedia

UKNC Imagen: wikipedia

Orion-128 Imagen: wikipedia

Orion-128 Imagen: wikipedia

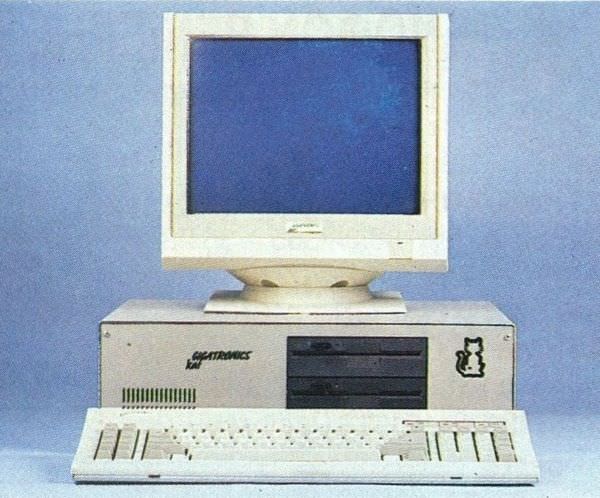

El Gigatronics KAT. Imagen: retrocomputers.gr

El Gigatronics KAT. Imagen: retrocomputers.gr

El Alphatronic PC de Triumph-Adler. Imagen: retroordenadoresorty.blogspot.com

El Alphatronic PC de Triumph-Adler. Imagen: retroordenadoresorty.blogspot.com

El Schneider CPC464 con su característica estética sobria. Imagen: Wikipedia

El Schneider CPC464 con su característica estética sobria. Imagen: Wikipedia

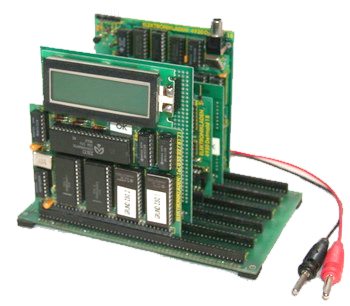

Módulos del NDR-Klein-Computer con pantalla LCD. Imagen: ndr-nkc.de

Módulos del NDR-Klein-Computer con pantalla LCD. Imagen: ndr-nkc.de

El Olivetti Prodest PC128 con casete integrado. Imagen: retroordenadoresorty.blogspot.com

El Olivetti Prodest PC128 con casete integrado. Imagen: retroordenadoresorty.blogspot.com

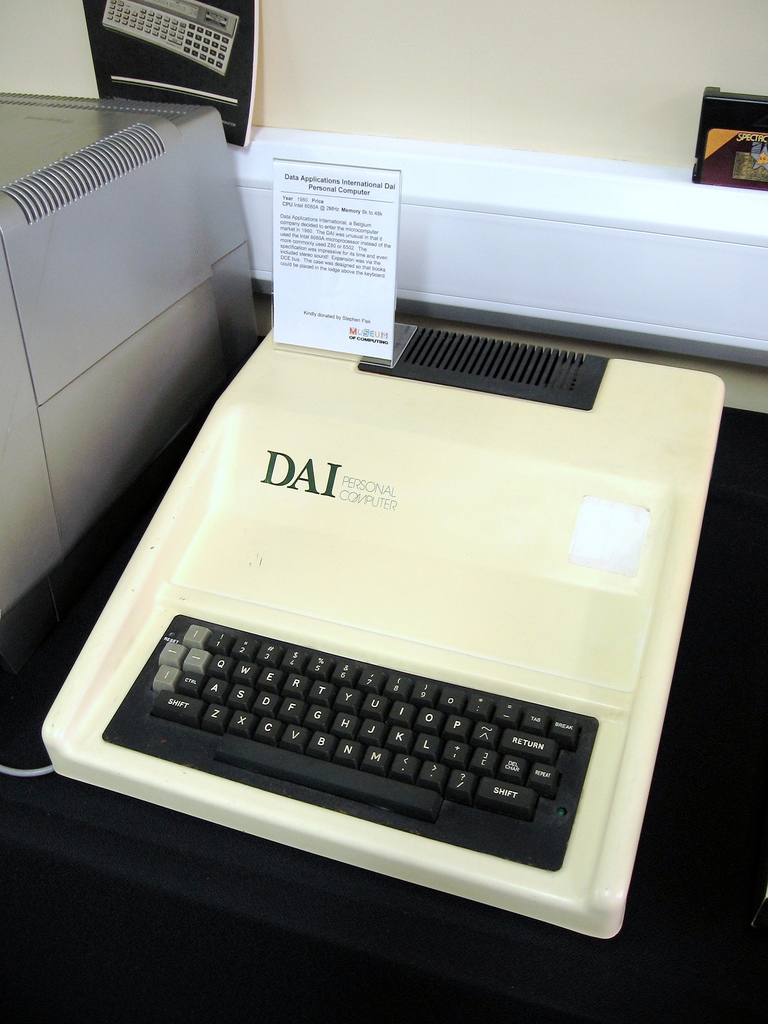

El DAI Personal Computer y su avanzado diseño belga. Imagen: Wikipedia

El DAI Personal Computer y su avanzado diseño belga. Imagen: Wikipedia

La estación de trabajo suiza Lilith. Imagen: Wikipedia

La estación de trabajo suiza Lilith. Imagen: Wikipedia

El danés RC Piccoline, diseñado para resistir las aulas. Imagen: Wikipedia

El danés RC Piccoline, diseñado para resistir las aulas. Imagen: Wikipedia

El sistema MUPID austríaco de telecomunicación. Imagen: Wikipedia

El sistema MUPID austríaco de telecomunicación. Imagen: Wikipedia

El TIKI 100 en un laboratorio escolar. Imagen: Wikipedia

El TIKI 100 en un laboratorio escolar. Imagen: Wikipedia

El Salora Fellow finlandés basado en tecnología VTech. Imagen: Wikipedia

El Salora Fellow finlandés basado en tecnología VTech. Imagen: Wikipedia

El rarísimo Hanimex Pencil II. Imagen: Rare & Old Computer

El rarísimo Hanimex Pencil II. Imagen: Rare & Old Computer

Imagen: Wikimedia Commons (CC BY-SA)

Imagen: Wikimedia Commons (CC BY-SA)

Imagen: Wikimedia Commons (CC BY-SA)

Imagen: Wikimedia Commons (CC BY-SA)